1. Kehidupan Awal dan Pendidikan

Timnit Gebru memiliki latar belakang yang membentuk pandangan kritisnya terhadap teknologi dan masyarakat, bermula dari pengalaman awal kehidupannya di Ethiopia dan cabaran yang dihadapinya selepas berhijrah ke Amerika Syarikat.

1.1. Kelahiran dan Latar Belakang

Gebru dilahirkan dan dibesarkan di Addis Ababa, Ethiopia, pada sekitar tahun 1982 atau 1983. Kedua-dua ibu bapanya berasal dari Eritrea. Bapanya, seorang jurutera elektrik dengan PhD, meninggal dunia ketika Gebru berumur lima tahun, dan beliau kemudiannya dibesarkan oleh ibunya yang seorang ahli ekonomi. Beliau juga mempunyai dua kakak perempuan yang merupakan jurutera elektrik.

1.2. Penghijrahan dan Pengalaman di Amerika Syarikat

Pada usia 15 tahun, semasa Perang Eritrea-Ethiopia, Gebru melarikan diri dari Ethiopia selepas beberapa ahli keluarganya dihantar pulang ke Eritrea dan dipaksa untuk berperang. Beliau pada mulanya ditolak visa A.S. dan sempat tinggal sebentar di Republik Ireland, namun akhirnya menerima suaka politik di Amerika Syarikat, pengalaman yang beliau sifatkan sebagai "menyedihkan".

Gebru menetap di Somerville, Massachusetts, untuk menghadiri sekolah menengah. Di sana, beliau segera mengalami diskriminasi kaum, dengan beberapa guru enggan membenarkannya mengambil kursus Advanced Placement tertentu, walaupun beliau seorang pelajar yang cemerlang. Selepas menamatkan sekolah menengah, pertemuan dengan polis mengarahkan Gebru ke arah fokus pada etika dalam teknologi. Seorang rakannya, seorang wanita kulit hitam, diserang di sebuah bar, dan Gebru memanggil polis untuk melaporkannya. Beliau menyatakan bahawa rakannya telah ditangkap dan ditahan di dalam sel, bukannya laporan serangan yang difailkan. Gebru menyebutnya sebagai "detik penting" dan "contoh terang-terangan perkauman sistemik", yang mencetuskan minatnya terhadap etika teknologi.

1.3. Pendidikan dan Permulaan Kerjaya Penyelidikan

Pada tahun 2001, Gebru diterima di Universiti Stanford. Beliau memperoleh ijazah Sarjana Muda Sains dan Sarjana Sains dalam kejuruteraan elektrik, dan kemudian memperoleh PhD dalam visi komputer pada tahun 2017. Semasa program PhD beliau, Gebru dibimbing oleh Fei-Fei Li.

Semasa program PhD beliau pada tahun 2016 dan 2018, Gebru kembali ke Ethiopia dengan kempen pengaturcaraan AddisCoder oleh Jelani Nelson. Beliau juga membentangkan penyelidikan kedoktorannya pada pertandingan LDV Capital Vision Summit 2017, di mana saintis visi komputer membentangkan hasil kerja mereka kepada ahli industri dan pemodal teroka. Gebru memenangi pertandingan itu, memulakan siri kerjasama dengan usahawan dan pelabur lain.

Semasa bekerja untuk PhDnya, Gebru mengarang kertas kerja yang tidak pernah diterbitkan mengenai kebimbangannya terhadap masa depan AI. Beliau menulis tentang bahaya kekurangan kepelbagaian dalam bidang itu, berpusat pada pengalamannya dengan polis dan siasatan ProPublica mengenai kepolisan ramalan, yang mendedahkan unjutan bias manusia dalam pembelajaran mesin. Dalam kertas kerja itu, beliau mengkritik "budaya kelab lelaki", merenungkan pengalamannya di perhimpunan persidangan di mana peserta lelaki yang mabuk mengganggu beliau secara seksual, dan mengkritik pemujaan selebriti bidang tersebut.

2. Kerjaya dan Aktiviti

Kerjaya Timnit Gebru ditandai dengan transisinya dari pembangunan perkakasan dan perisian kepada perintis penyelidikan etika AI, yang membawa kepada kontroversi pemecatan beliau dari Google dan penubuhan institut penyelidikan bebasnya sendiri.

2.1. Kerjaya Awal (Apple, Microsoft)

Gebru menyertai Apple sebagai pelatih semasa di Stanford, bekerja di bahagian perkakasan mereka membuat litar elektronik untuk komponen audio, dan ditawarkan jawatan sepenuh masa pada tahun berikutnya. Mengenai kerjanya sebagai jurutera audio, pengurusnya memberitahu Wired bahawa beliau "tidak gentar" dan disukai oleh rakan sekerjanya. Semasa tempohnya di Apple, Gebru menjadi lebih berminat dalam membina perisian, iaitu visi komputer yang boleh mengesan figura manusia. Beliau kemudiannya membangunkan algoritma pemprosesan isyarat untuk iPad pertama. Pada masa itu, beliau berkata beliau tidak mempertimbangkan potensi penggunaan untuk pengawasan, dengan menyatakan "Saya hanya mendapatinya menarik dari segi teknikal."

Lama selepas meninggalkan syarikat itu, semasa pergerakan AppleToo pada musim panas 2021, yang diketuai oleh jurutera Apple Cher Scarlett, yang berunding dengan Gebru, Gebru mendedahkan bahawa beliau mengalami "begitu banyak perkara yang keterlaluan" dan "sentiasa tertanya-tanya bagaimana mereka berjaya keluar dari perhatian." Beliau berkata bahawa akauntabiliti di Apple sudah lama tertunggak, dan memberi amaran bahawa mereka tidak boleh terus bersembunyi untuk tempoh yang lebih lama. Gebru juga mengkritik cara media meliput Apple dan gergasi teknologi lain, dengan mengatakan bahawa akhbar membantu melindungi syarikat-syarikat tersebut daripada penelitian awam.

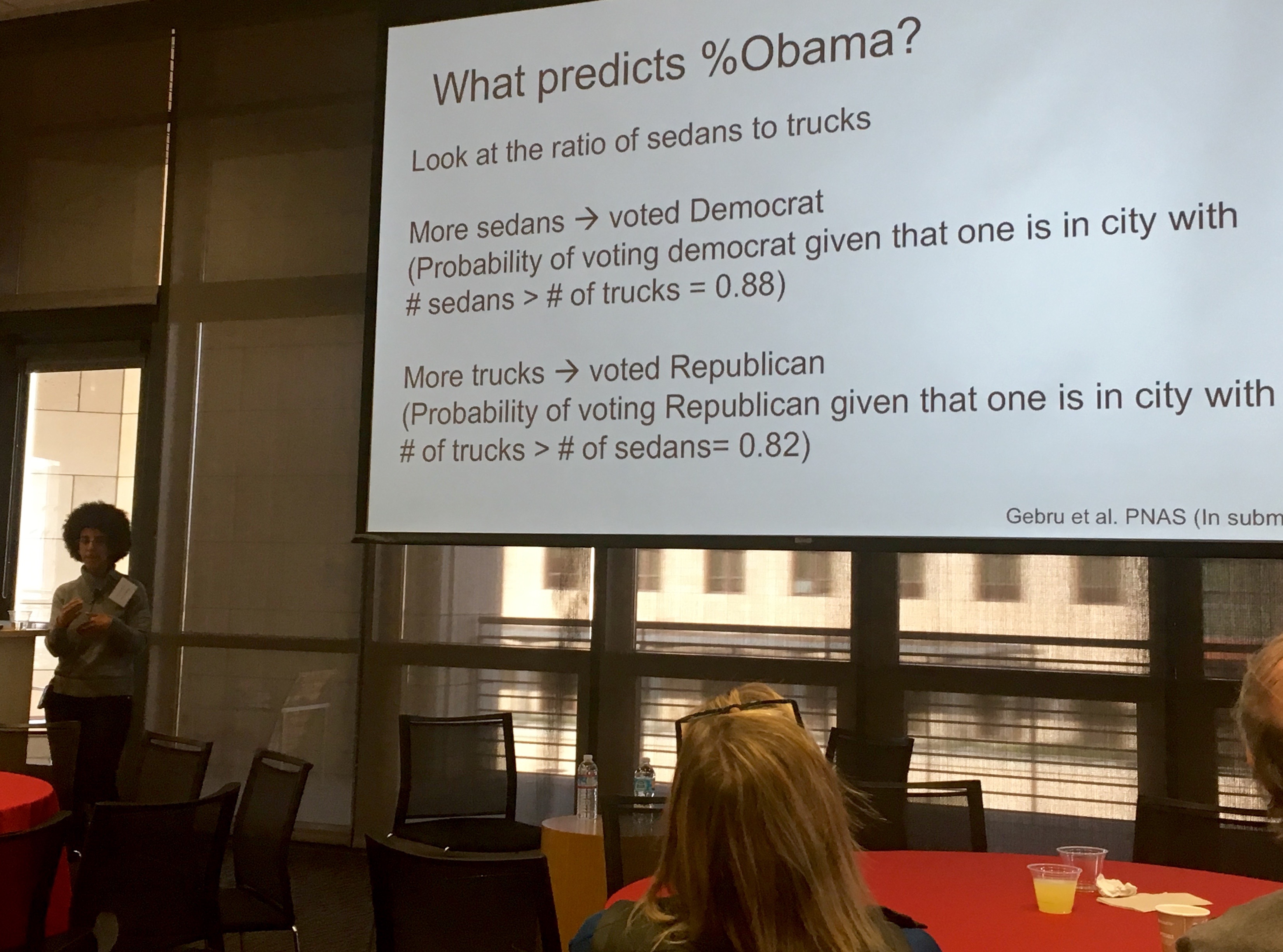

Pada tahun 2013, Gebru menyertai makmal Fei-Fei Li di Stanford. Beliau menggunakan perlombongan data imej yang tersedia secara umum. Beliau berminat dengan jumlah wang yang dibelanjakan oleh organisasi kerajaan dan bukan kerajaan yang cuba mengumpul maklumat tentang komuniti. Untuk menyiasat alternatif, Gebru menggabungkan pembelajaran mendalam dengan Google Street View untuk menganggarkan demografi kejiranan Amerika Syarikat, menunjukkan bahawa atribut sosioekonomi seperti corak pengundian, pendapatan, kaum, dan pendidikan boleh disimpulkan daripada pemerhatian kereta. Jika bilangan trak pikap melebihi bilangan sedan, komuniti tersebut lebih cenderung untuk mengundi parti Republikan. Mereka menganalisis lebih daripada 15 juta imej dari 200 bandar paling padat penduduk di A.S. Kerja ini diliput secara meluas dalam media, diambil oleh BBC News, Newsweek, The Economist, dan The New York Times.

Pada tahun 2015, Gebru menghadiri persidangan terkemuka bidang itu, Neural Information Processing Systems (NIPS), di Montreal, Kanada. Daripada 3,700 peserta, beliau menyatakan bahawa beliau adalah salah seorang daripada beberapa penyelidik kulit hitam. Apabila beliau menghadiri lagi pada tahun berikutnya, beliau mencatat dan mendapati bahawa hanya terdapat lima lelaki kulit hitam dan beliau adalah satu-satunya wanita kulit hitam daripada 8,500 perwakilan. Bersama rakan sekerjanya Rediet Abebe, Gebru mengasaskan Black in AI, sebuah komuniti penyelidik kulit hitam yang bekerja dalam kecerdasan buatan. Black in AI bertujuan untuk mendemokrasikan akses kepada bidang kecerdasan buatan (AI) dengan meningkatkan kehadiran, keterlihatan, dan kesejahteraan profesional dan pemimpin kulit hitam dalam bidang tersebut.

Pada musim panas 2017, Gebru menyertai Microsoft sebagai penyelidik pasca-doktoral di makmal Keadilan, Akauntabiliti, Ketelusan, dan Etika dalam AI (FATE). Pada tahun 2017, Gebru berucap di persidangan Keadilan dan Ketelusan, di mana MIT Technology Review menemu bual beliau mengenai bias yang wujud dalam sistem AI dan bagaimana menambah kepelbagaian dalam pasukan AI dapat menyelesaikan masalah itu. Dalam temu bualnya dengan Jackie Snow, Snow bertanya kepada Gebru, "Bagaimana kekurangan kepelbagaian memesongkan kecerdasan buatan dan khususnya visi komputer?" dan Gebru menunjukkan bahawa terdapat bias yang wujud dalam pembangun perisian. Semasa di Microsoft, Gebru bersama-sama mengarang kertas penyelidikan yang dipanggil Gender Shades, yang menjadi nama projek yang lebih luas dari projek Massachusetts Institute of Technology yang diketuai oleh pengarang bersama Joy Buolamwini. Pasangan itu menyiasat sistem pengecaman muka, mendapati bahawa dalam satu pelaksanaan tertentu wanita kulit hitam 35% kurang berkemungkinan dikenali berbanding lelaki kulit putih.

2.2. Penyelidikan Etika AI di Google

Gebru menyertai Google pada tahun 2018, di mana beliau bersama-sama mengetuai pasukan mengenai etika kecerdasan buatan dengan Margaret Mitchell. Beliau mengkaji implikasi kecerdasan buatan, berusaha untuk meningkatkan keupayaan teknologi untuk melakukan kebaikan sosial.

Pada tahun 2019, Gebru dan penyelidik kecerdasan buatan lain "menandatangani surat yang menyeru Amazon untuk berhenti menjual teknologi pengecaman muka kepada agensi penguatkuasaan undang-undang kerana ia berat sebelah terhadap wanita dan orang kulit berwarna", memetik kajian yang dijalankan oleh penyelidik MIT yang menunjukkan bahawa sistem pengecaman muka Amazon mempunyai lebih banyak masalah mengenal pasti wanita berkulit gelap berbanding perisian pengecaman muka syarikat teknologi lain. Dalam temu bual The New York Times, Gebru seterusnya menyatakan bahawa beliau percaya pengecaman muka terlalu berbahaya untuk digunakan bagi tujuan penguatkuasaan undang-undang dan keselamatan pada masa ini.

2.3. Penulisan 'Stochastic Parrots' dan Keluar dari Google

Pada tahun 2020, Gebru dan lima pengarang bersama menulis kertas kerja bertajuk "On the Dangers of Stochastic Parrots: Can Language Models Be Too Big? 🦜" (Mengenai Bahaya Burung Nuri Stokastik: Bolehkah Model Bahasa Terlalu Besar? 🦜). Kertas kerja itu meneliti risiko model bahasa besar (LLM) yang sangat besar, termasuk jejak karbon alam sekitar, kos kewangan, ketidakjelasan model besar, potensi LLM untuk menunjukkan prasangka terhadap kumpulan tertentu, ketidakupayaan LLM untuk memahami bahasa yang mereka proses, dan penggunaan LLM untuk menyebarkan maklumat salah.

Pada Disember 2020, pekerjaannya dengan Google berakhir selepas pengurusan Google memintanya untuk menarik balik kertas kerja itu sebelum diterbitkan, atau membuang nama semua pekerja Google daripada kertas kerja itu. Daripada enam pengarang, hanya Emily M. Bender yang pada masa itu tidak bekerja di Google. Dalam surat enam halaman yang dihantar ke senarai kerjasama dalaman, Gebru menerangkan bagaimana beliau dipanggil ke mesyuarat secara notis singkat di mana beliau diminta untuk menarik balik kertas kerja itu dan beliau meminta untuk mengetahui nama dan alasan setiap orang yang membuat keputusan itu, bersama-sama dengan nasihat tentang cara menyemaknya mengikut kehendak Google. Beliau berkata beliau akan bekerjasama dengan Google mengenai tarikh tamat pekerjaan selepas tempoh masa yang sesuai jika maklumat itu tidak diberikan. Google tidak memenuhi permintaannya dan menamatkan pekerjaannya serta-merta, mengisytiharkan bahawa mereka menerima perletakan jawatannya. Gebru menegaskan bahawa beliau tidak secara rasmi menawarkan untuk meletak jawatan, dan hanya mengancam untuk berbuat demikian.

Jeff Dean, ketua penyelidikan AI Google, membalas dengan e-mel yang mengatakan bahawa mereka membuat keputusan itu kerana kertas kerja itu mengabaikan terlalu banyak penyelidikan terkini yang relevan mengenai cara mengurangkan beberapa masalah yang diterangkan di dalamnya, mengenai impak alam sekitar, dan bias model-model ini. Dean kemudian menerbitkan e-mel dalamannya mengenai pemergian Gebru dan pemikirannya mengenai perkara itu, mempertahankan proses kertas penyelidikan Google untuk "menangani masalah yang bercita-cita tinggi, tetapi melakukannya secara bertanggungjawab." Gebru dan pihak lain menyalahkan penerbitan awal ini, dan kebisuan Dean seterusnya mengenai perkara itu, yang menurut Gebru telah memangkinkan dan membolehkan gangguan yang berlaku sejurus selepas responsnya. Gebru diganggu secara bersiri oleh beberapa akaun boneka dan troll internet di Twitter, membuat komen perkauman dan lucah. Gebru dan penyokongnya mendakwa bahawa beberapa gangguan itu datang daripada penyelidik pembelajaran mesin Pedro Domingos dan ahli perniagaan Michael Lissack, yang mengatakan bahawa kerjanya adalah "advokasi yang menyamar sebagai sains". Lissack juga didakwa mengganggu Mitchell dan Bender, bersama-sama dengan rakan sekerja lain dalam bekas pasukan Gebru. Twitter menggantung sementara akses akaun Lissack pada 1 Februari 2021.

Gebru berulang kali menegaskan bahawa beliau dipecat, dan hampir 2,700 pekerja Google serta lebih daripada 4,300 ahli akademik dan penyokong masyarakat sivil menandatangani surat mengutuk pemecatan Gebru. Sembilan ahli Kongres menghantar surat kepada Google meminta penjelasan mengenai keadaan sekitar pemergian Timnit Gebru. Bekas pasukan Gebru menuntut agar Naib Presiden Megan Kacholia dikeluarkan daripada rantaian pengurusan pasukan itu. Kacholia didakwa memecat Gebru tanpa memberitahu pengurus langsung Gebru, Samy Bengio, terlebih dahulu, dan bekas pasukan Gebru menuntut Kacholia dan Dean memohon maaf atas cara Gebru dilayan. Mitchell menggunakan Twitter untuk mengkritik layanan Google terhadap pekerja yang berusaha untuk menghapuskan bias dan ketoksikan dalam AI, termasuk dakwaan pemecatan Gebru. Mitchell kemudiannya ditamatkan perkhidmatannya kerana didakwa mengeksfiltrasi dokumen sulit sensitif perniagaan dan data peribadi pekerja lain.

Berikutan publisiti negatif mengenai keadaan pemergiannya, Sundar Pichai, CEO Alphabet, syarikat induk Google, secara terbuka memohon maaf di Twitter tanpa menjelaskan sama ada Gebru ditamatkan perkhidmatan atau meletak jawatan dan memulakan siasatan selama berbulan-bulan mengenai insiden itu. Setelah selesai semakan, Dean mengumumkan bahawa Google akan mengubah "pendekatan untuk mengendalikan cara pekerja tertentu meninggalkan syarikat", tetapi masih tidak menjelaskan sama ada pemergian Gebru dari Google adalah secara sukarela. Selain itu, Dean berkata akan ada perubahan pada cara kertas penyelidikan dengan topik "sensitif" akan disemak, dan matlamat kepelbagaian, ekuiti, dan keterangkuman akan dilaporkan kepada lembaga pengarah Alphabet setiap suku tahun. Gebru menulis di Twitter bahawa beliau "tidak mengharapkan apa-apa lagi" dari Google dan menunjukkan bahawa perubahan itu adalah disebabkan permintaan yang didakwa menyebabkan beliau ditamatkan perkhidmatan tetapi tiada siapa yang dipertanggungjawabkan untuknya. Selepas itu, dua pekerja Google meletak jawatan dari jawatan mereka di syarikat itu.

Berikutan pemergiannya, Google mengadakan forum untuk membincangkan pengalaman dengan perkauman di syarikat itu, dan pekerja melaporkan kepada NBC News bahawa separuh daripada forum itu dihabiskan untuk mendiskreditkan Gebru, yang mereka anggap sebagai syarikat yang menjadikannya contoh kerana bersuara. Forum itu diikuti dengan sesi psikoterapi kumpulan untuk pekerja kulit hitam Google dengan ahli terapi berlesen, yang menurut pekerja adalah tidak menghiraukan kemudaratan yang mereka rasa telah disebabkan oleh dakwaan penamatan perkhidmatan Gebru. Gebru, dan pihak lain, percaya bahawa dakwaan pemecatannya adalah tindakan balas dan bukti bahawa Google adalah perkauman secara institusi. Google berkata bahawa ia "terus memberi tumpuan kepada kerja penting ini dan menyiasat secara menyeluruh sebarang kebimbangan, untuk memastikan [Google] adalah representatif dan adil."

2.4. Penubuhan Institut Penyelidikan Kecerdasan Buatan Teragih (DAIR)

Pada Jun 2021, Gebru mengumumkan bahawa beliau sedang mengumpul dana untuk "melancarkan sebuah institut penyelidikan bebas yang dimodelkan berdasarkan kerjanya dalam pasukan AI Etika Google dan pengalamannya dalam Black in AI."

Pada 2 Disember 2021, beliau melancarkan Distributed Artificial Intelligence Research Institute (DAIR), yang dijangka mendokumentasikan kesan kecerdasan buatan terhadap kumpulan terpinggir, dengan tumpuan kepada Afrika dan imigran Afrika di Amerika Syarikat. Salah satu projek awal organisasi itu merancang untuk menganalisis imej satelit perbandaran di Afrika Selatan dengan AI untuk lebih memahami legasi apartheid.

3. Bidang Penyelidikan Utama dan Sumbangan

Penyelidikan Timnit Gebru secara konsisten menumpukan pada pendedahan dan mitigasi bias dalam sistem AI, dengan penekanan kuat pada keadilan sosial dan impak teknologi terhadap masyarakat.

3.1. Bias Algoritma dan Keadilan

Gebru telah menjalankan kajian mendalam mengenai bias yang wujud dalam sistem AI dan kaedah untuk mengurangkannya, sentiasa menekankan pentingnya keadilan dan kesaksamaan. Beliau telah menyatakan bahawa bias dalam sistem AI sering berpunca daripada bias yang sedia ada dalam pembangun perisian itu sendiri, menekankan keperluan untuk kepelbagaian dalam pasukan AI untuk menangani isu ini. Beliau telah membincangkan isu bias dalam kecerdasan buatan dalam pelbagai podcast dan temu bual, menyumbang kepada kesedaran awam yang lebih luas mengenai topik ini.

3.2. Teknologi Pengecaman Muka dan Perbezaan Jantina/Kaum

Salah satu sumbangan penyelidikan Gebru yang paling berpengaruh ialah kertas kerja "Gender Shades", yang ditulis bersama Joy Buolamwini. Penyelidikan ini mendedahkan ketidaktepatan yang signifikan dalam perisian pengecaman muka komersial, terutamanya terhadap wanita berkulit gelap. Dalam satu pelaksanaan tertentu, wanita kulit hitam 35% kurang berkemungkinan dikenali berbanding lelaki kulit putih.

Pada tahun 2019, Gebru dan penyelidik AI lain menandatangani surat yang menyeru Amazon untuk menghentikan penjualan teknologi pengecaman muka kepada agensi penguatkuasaan undang-undang, memetik bias terhadap wanita dan orang kulit berwarna. Beliau berpendapat bahawa teknologi pengecaman muka terlalu berbahaya untuk digunakan bagi tujuan penguatkuasaan undang-undang dan keselamatan pada masa ini, memandangkan ketidaktepatan dan potensi penyalahgunaannya. Atas penyelidikan ini, Gebru, Buolamwini, dan Inioluwa Deborah Raji memenangi Anugerah Inovasi AI VentureBeat 2019 dalam kategori "AI for Good".

3.3. Bahaya Model Bahasa Besar (LLM)

Gebru adalah pengkritik vokal terhadap model bahasa besar (LLM), terutamanya melalui kertas kerja "On the Dangers of Stochastic Parrots: Can Language Models Be Too Big? 🦜". Kertas kerja ini menganalisis pelbagai risiko yang berkaitan dengan LLM, termasuk:

- Jejak Alam Sekitar: Kos tenaga dan alam sekitar yang tinggi untuk melatih model-model ini.

- Kos Kewangan: Perbelanjaan besar yang diperlukan untuk pembangunan dan operasi LLM.

- Ketidakjelasan: Sifat "kotak hitam" model besar yang menjadikannya sukar untuk memahami bagaimana mereka mencapai keputusan, yang boleh membawa kepada bias yang tidak dijangka dan berbahaya.

- Prasangka: Potensi LLM untuk memaparkan dan mengukuhkan prasangka yang terdapat dalam data latihan mereka.

- Ketidakupayaan Memahami Bahasa: LLM tidak benar-benar "memahami" bahasa yang mereka proses; mereka hanya memadankan corak, yang boleh menyebabkan output yang tidak masuk akal atau tidak sesuai.

- Penyebaran Maklumat Salah: Risiko LLM digunakan untuk menjana dan menyebarkan maklumat salah atau disinformasi secara besar-besaran.

3.4. Etika AI dan Impak Sosial

Gebru secara konsisten mengkaji kesan etika dan sosial AI terhadap masyarakat, terutamanya kumpulan terpinggir, dan mencadangkan penambahbaikan. Beliau percaya bahawa pembangunan AI harus memberi tumpuan kepada kebaikan sosial dan mengelakkan kemudaratan.

Beliau dan Émile P. Torres mencipta akronim neologisme TESCREAL untuk mengkritik apa yang mereka lihat sebagai sekumpulan falsafah futurisme yang bertindih: transhumanisme, extropianisme, singularitarianisme, kosmisme, rasionalisme, altruisme efektif, dan longtermisme. Gebru menganggap ini sebagai pengaruh berhaluan kanan dalam Big Tech dan membandingkan penyokongnya dengan "eugenis abad ke-20" dalam penghasilan projek berbahaya yang mereka gambarkan sebagai "memberi manfaat kepada kemanusiaan." Gebru telah mengkritik penyelidikan ke dalam kecerdasan umum buatan (AGI) sebagai berakar umbumi dalam eugenik. Gebru menyatakan bahawa fokus harus dialihkan dari AGI dan bahawa cuba membina AGI adalah amalan yang secara semula jadi tidak selamat.

4. Pergerakan Sosial dan Aktivisme

Timnit Gebru adalah seorang advokat dan aktivis yang bersemangat untuk kepelbagaian dan keadilan sosial dalam bidang teknologi, terutamanya dalam kecerdasan buatan.

4.1. Pengasas Bersama Black in AI dan Aktiviti

Pada tahun 2016, Gebru menghadiri persidangan Neural Information Processing Systems (NIPS) di Montreal, Kanada. Daripada 3,700 peserta, beliau mendapati bahawa beliau adalah salah seorang daripada beberapa penyelidik kulit hitam. Apabila beliau menghadiri lagi pada tahun berikutnya, beliau mencatat dan mendapati bahawa hanya terdapat lima lelaki kulit hitam dan beliau adalah satu-satunya wanita kulit hitam daripada 8,500 perwakilan.

Bersama rakan sekerjanya Rediet Abebe, Gebru mengasaskan Black in AI, sebuah komuniti penyelidik kulit hitam yang bekerja dalam kecerdasan buatan. Black in AI bertujuan untuk mendemokrasikan akses kepada bidang kecerdasan buatan (AI) dengan meningkatkan kehadiran, keterlihatan, dan kesejahteraan profesional dan pemimpin kulit hitam dalam bidang tersebut. Black in AI telah mengadakan bengkel di persidangan NIPS tahunan sejak tahun 2017.

4.2. Promosi Kepelbagaian dan Keterangkuman dalam Teknologi

Gebru secara aktif mempromosikan kepelbagaian dan keterangkuman dalam bidang teknologi, terutamanya dalam penyelidikan AI dan bidang STEM. Beliau sering menyoroti kekurangan representasi wanita dan minoriti, dan berpendapat bahawa kepelbagaian dalam pasukan pembangunan AI adalah penting untuk mengurangkan bias dalam sistem AI. Beliau juga telah menyuarakan kebimbangan mengenai "budaya kelab lelaki" dalam bidang tersebut dan mengkritik pemujaan selebriti yang boleh menghalang kepelbagaian.

4.3. Kritikan TESCREAL dan Etika Teknologi

Gebru adalah pengkritik vokal terhadap falsafah teknologi tertentu yang beliau percaya menyumbang kepada masalah etika dan sosial dalam AI. Bersama Émile P. Torres, beliau mencipta akronim TESCREAL untuk merujuk kepada sekumpulan falsafah futurisme yang bertindih: transhumanisme, extropianisme, singularitarianisme, kosmisme, rasionalisme, altruisme efektif, dan longtermisme.

Beliau menganggap falsafah-falsafah ini sebagai pengaruh berhaluan kanan dalam syarikat teknologi besar dan membandingkan penyokongnya dengan eugenis abad ke-20, yang menghasilkan projek berbahaya yang mereka gambarkan sebagai "memberi manfaat kepada kemanusiaan." Gebru juga secara khusus mengkritik penyelidikan ke dalam kecerdasan umum buatan (AGI) sebagai berakar umbi dalam eugenik, menegaskan bahawa fokus harus dialihkan dari AGI kerana ia adalah amalan yang secara semula jadi tidak selamat. Pandangan kritis ini mencerminkan komitmennya untuk memastikan pembangunan teknologi beretika dan bertanggungjawab.

5. Anugerah dan Pengiktirafan

Timnit Gebru telah menerima pelbagai anugerah dan pengiktirafan atas sumbangan pentingnya dalam bidang etika kecerdasan buatan dan advokasi sosial.

- 2019:** Gebru, bersama Joy Buolamwini dan Inioluwa Deborah Raji, memenangi Anugerah Inovasi AI VentureBeat dalam kategori "AI for Good" atas penyelidikan mereka yang menonjolkan masalah signifikan bias algoritma dalam pengecaman muka.

- 2021:** Dinamakan sebagai salah seorang daripada 50 Pemimpin Terhebat Dunia oleh majalah Fortune.

- 2021:** Termasuk dalam senarai sepuluh saintis yang memainkan peranan penting dalam perkembangan saintifik pada tahun 2021, yang disusun oleh jurnal saintifik Nature.

- 2022:** Dinamakan sebagai salah seorang individu paling berpengaruh pada tahun 2022 oleh majalah Time.

- 2023:** Dinamakan oleh Carnegie Corporation of New York sebagai penerima Anugerah Imigran Hebat, sebagai pengiktirafan atas sumbangan pentingnya dalam bidang etika kecerdasan buatan.

- 2023:** Dimasukkan dalam senarai "100 Wanita BBC" oleh BBC, sebagai salah seorang wanita paling inspirasi dan berpengaruh di dunia.

6. Impak dan Warisan

Timnit Gebru telah meninggalkan impak yang mendalam dalam bidang etika kecerdasan buatan, amalan industri teknologi, dan representasi kumpulan terpinggir dalam STEM. Penyelidikan perintisnya mengenai bias algoritma, terutamanya melalui projek "Gender Shades", telah mengubah cara komuniti AI memahami dan menangani ketidakadilan dalam sistem pengecaman muka. Kerjanya telah memaksa syarikat-syarikat teknologi besar untuk menghadapi isu-isu bias dalam produk mereka dan telah mendorong perbincangan yang lebih luas mengenai tanggungjawab sosial AI.

Pemergian kontroversinya dari Google menjadi titik tolak bagi pergerakan yang menuntut akauntabiliti yang lebih besar dari syarikat teknologi mengenai etika AI dan layanan pekerja. Insiden ini telah meningkatkan kesedaran tentang perkauman institusi dan diskriminasi dalam industri teknologi, mendorong perbincangan dan siasatan dalaman serta luaran.

Sebagai pengasas bersama Black in AI dan pengasas Distributed Artificial Intelligence Research Institute (DAIR), Gebru telah secara aktif membina ruang dan peluang untuk penyelidik kulit hitam dan kumpulan terpinggir lain dalam bidang AI. Usahanya telah membantu mendemokrasikan akses kepada penyelidikan AI dan meningkatkan keterlihatan serta kesejahteraan profesional kulit hitam. Melalui DAIR, beliau terus meneroka kesan AI terhadap komuniti terpinggir, terutamanya di Afrika dan di kalangan imigran Afrika di Amerika Syarikat, memastikan bahawa penyelidikan AI adalah relevan dan memberi manfaat kepada semua.

Kritikan vokal Gebru terhadap falsafah teknologi yang beliau anggap berbahaya, seperti TESCREAL, dan pendiriannya yang tegas terhadap pembangunan AGI, telah mencabar naratif dominan dalam komuniti AI. Beliau telah mendesak agar bidang tersebut beralih daripada "kelab lelaki" dan pemujaan selebriti kepada pendekatan yang lebih inklusif dan beretika, yang memberi keutamaan kepada keadilan sosial dan mengelakkan kemudaratan. Secara keseluruhan, Gebru kekal sebagai suara yang berpengaruh dan kritikal, membentuk masa depan etika AI dan advokasi untuk masyarakat yang lebih adil dalam teknologi.

7. Pautan Luar

- [https://ai.stanford.edu/~tgebru/ Profil] di Universiti Stanford